Warum Autofahren schwierig ist – sogar für KI

Ich habe ein paar Kinder im Führerscheinalter, und es ist meine väterliche Pflicht, ihnen ein paar Tipps für das Autofahren zu geben, damit sie keine Gefahr für sich selbst und alle anderen darstellen. Also habe ich meine Fahrweise analysiert: Woher wusste ich, dass der andere Fahrer vor mir links abbiegen würde? Warum achte ich auf den unangeleinten Hund auf dem Gehweg, aber nicht auf die Äste der Bäume über mir? Welche unterbewussten Hinweise sagen mir, dass eine Ampel gleich auf Rot schaltet oder dass sich die Tür eines geparkten Autos öffnen wird?

Diese Übung hat mir ein neues Verständnis für die schreckliche Komplexität des Autofahrens vermittelt – und das sind nur die Dinge, über die ich nachdenken kann. Das Auto selbst kümmert sich bereits um eine Million Details, die dafür sorgen, dass das Auto fährt, anhält und lenkt, und dieser Prozess war komplex genug, als ich noch jung war und die Autos im Wesentlichen mechanisch und elektrisch waren. Heute sind Autos zu rollenden Computern geworden, bei denen der Mensch (höchstens) die Geschwindigkeit, die Richtung und den Komfort steuert.

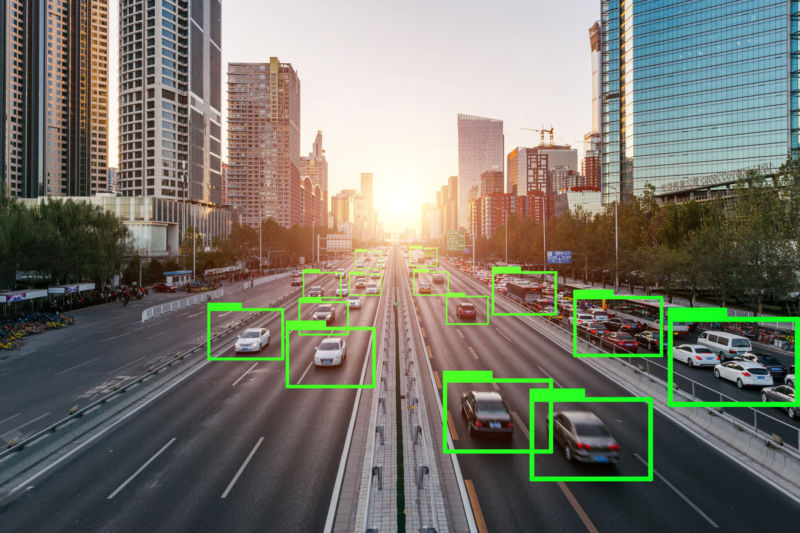

Damit ein Fahrzeug auch nur annähernd autonom fahren kann, muss es die augenblicklichen Veränderungen in seiner unmittelbaren Umgebung verstehen und wissen, was sie bedeuten. Es muss wissen, wie es reagieren kann. Und es muss die wichtigen Dinge in der Nähe kennen, die sich nicht verändern, z. B. wo sich Häuser und Bäume befinden.

Das ist schwierig. Uber hat sein Programm für autonome Autos Anfang 2018 ausgesetzt, als eines seiner Autos einen Radfahrer angefahren und getötet hat. Das Unternehmen wartete bis zum Ende des Jahres, um eine Erlaubnis zu beantragen (die es technisch nicht brauchte), um sie wieder auf die Straße in Pittsburgh zu bringen, wo sie vor dem Unfall ein nicht unüblicher Anblick waren.

Die Society for Automotive Engineering und das US-Verkehrsministerium legen sechs Autonomiestufen fest, die von Stufe 0 (menschliche Fahrer mit vollständiger Kontrolle) bis Stufe 5 (ein vollständig selbstfahrendes Fahrzeug) reichen. Das kommerziell erhältliche Auto, das derzeit als das autonomste gilt – der Cadillac CT6 mit Super Cruise – erreicht Level 2… aber nur auf den 130.000 Meilen (viele davon auf Autobahnen), die seine Karten kennen. Der Autopilot-Modus von Tesla wird ungeachtet des Namens ebenfalls als Stufe 2 eingestuft. Keines der beiden Systeme ist so etwas wie einsatzbereite Systeme.

Daimler testet mit einigem Erfolg autonome Lastwagen auf ausgewählten deutschen Autobahnen. Aber Straßen mit begrenztem Zugang, gut markierten Fahrspuren und nur wenigen Stellen zum Ein- und Aussteigen sind ein vergleichsweise einfaches Problem, vor allem in Deutschland, wo die Fahrer erfahren und berechenbar sind.

Waymo hat diese Woche offiziell einen kommerziellen selbstfahrenden Taxidienst gestartet – allerdings hat bisher nur eine kleine Gruppe Zugang dazu. Und GM sagt, dass es nächstes Jahr in San Francisco einen vollständig autonomen Taxidienst auf die Straße bringen wird (obwohl es viele Zweifler an diesem Zeitplan gibt). Volkswagen will 2021 autonome Elektroautos der Marke Moia auf den Markt bringen, also im selben Jahr, in dem Ford nach eigenen Angaben autonome Autos in Serie produzieren will. Toyota hingegen sagt, es werde KI einsetzen, um von Menschen gesteuerte Autos sicherer und unterhaltsamer zu machen (wie auch immer man „unterhaltsam“ misst).

Smarte Autos brauchen smarte Straßen

So smart ein Auto auch sein mag, es braucht eine ebenso smarte (wenn nicht sogar smartere) Infrastruktur um es herum. So schnell der Bordcomputer eines Autos auch sein mag, es muss auch in der Lage sein, zu lernen und seine Umgebung zu verstehen, um dann selbständig sofortige Entscheidungen treffen zu können – und es muss wissen, wann es bei Bedarf externe Ressourcen zu Rate ziehen muss.

Ein Beispiel: Sie „fahren“ an einem regnerischen Abend zu Ihrer Großmutter, als eine Katze über die Straße läuft. Das Auto muss ein plötzliches Hindernis sehen, es als solches erkennen und entscheiden, wie es damit umgehen soll; das erfordert eine schnelle, lokale, KI-gestützte Reaktion. Das Auto muss aber auch die örtliche Geschwindigkeitsbegrenzung kennen und wissen, ob es sich dem Wetter anpassen soll, was es ebenfalls verstehen muss. Einige dieser Informationen können aus entfernten Ressourcen stammen, wie z. B. hochgradig lokalisierte Wetterinformationen und eine maschinenverständliche Stadtkarte (die übrigens wahrscheinlich wie eine XML-Datei aussehen wird und nicht so, wie man sich eine Karte vorstellt). Da hohe Bandbreite und niedrige Latenzzeiten entscheidend sein werden, ist das eine Aufgabe für ein 5G-Netz.

Wenn andere Autos in der Nähe sind, wenn Ihr Auto der Katze ausweicht, sollte Ihr Auto auch mit ihnen kommunizieren können, damit sie sofort wissen, ob sie bremsen, ausweichen oder beschleunigen müssen; andernfalls könnte Ihr Auto sie statt der Katze treffen. Damit das funktioniert, brauchen Sie eine Fahrzeug-zu-Fahrzeug-Kommunikation (V2V), die einen interoperablen Industriestandard erfordert, den es noch nicht gibt.

Auf dem Weg zur Oma – die Sie nicht annähernd so oft besuchen, wie Sie sollten, und daher den Weg nicht wirklich kennen – wird Ihr Auto Entscheidungen über die beste Route treffen. Das bedeutet, dass es in Echtzeit über Verkehrssignale, Staus, Umleitungen oder Straßenbauarbeiten informiert werden möchte. Damit Ihr Auto all diese Gefahren erkennen kann, benötigt es ein Stück Infrastruktur, das V2X genannt wird – „vehicle to everything“ oder V2I (vehicle-to-infrastructure). Und da es noch eine ganze Weile dauern wird, bis alle Fahrzeuge auf der Straße selbstfahrend und sicher sind, muss Ihr Auto auch die schlechte Fahrweise der zahlreichen Fahrzeuge mit Autopilot berücksichtigen, die noch auf der Straße unterwegs sind.

Das sind eine Menge Ressourcen, nur um Sie und Ihre Großmutter bei Laune zu halten (ganz zu schweigen von der Katze und all den anderen Fahrzeugen auf der Straße). Die künstliche Intelligenz in Ihrem Auto ist nur der Anfang.

Einiges von dem, was wir hier sehen, ist schon in Arbeit. Las Vegas verfügt über ein Live-V2I-System, das bestimmten Audi-Modellen mitteilen kann, in welchem Zustand sich eine Ampel befindet und wie lange es noch dauert, bis die Ampel umschaltet. Nevada als Ganzes baut auch ein V2V-Netz auf.

Nichts davon berücksichtigt, was passiert, wenn Oma irgendwo in der Provinz wohnt, wo es kein 5G oder vernünftiges Mapping oder intelligente V2I-Infrastruktur gibt. Vielleicht muss man eines Tages, um in ländlichen Gegenden zu fahren, immer noch selbst ein Auto bedienen – so wie es auch heute noch praktisch ist, zu wissen, wie man eine Knüppelschaltung bedient.

Im Zentrum all dessen stehen KI und maschinelles Lernen. Autofahren ist eine lächerlich komplizierte Fähigkeit, die Erfahrung, Aufmerksamkeit und Reflexe erfordert. Doch bei aller Komplexität ist es eine endliche Fähigkeit mit verständlichen Anforderungen, Eingaben und Ergebnissen. Das Autofahren hat sich noch nicht der KI unterworfen, aber denken Sie daran: Wir lassen Kinder erst mit 16 Jahren hinter das Steuer. Der durchschnittliche Computer ist nicht so scharfsinnig wie ein 16-Jähriger. Aber er wird es sein, und vielleicht schon bald.

Was gut ist. Denn Oma ist mit FaceTime nicht zufrieden.